104 – Die nackte Wahrheit der künstlichen Intelligenz

oder

Der letzte Hype des Digitalismus

Die Digitalität bietet keinen Kritiküberschuss wie die Buchdruckgesellschaft, sondern einen Kontrollüberschuss.

Dirk Baecker

When information is cheap, context is more valuable than ever.

WIRED

1. Das Gespenst

Was glauben Sie? Werden die neuen Künstlichen-Intelligenz-Systeme die Welt zerstören? Oder die Menschheit retten?

Allein der Entweder-oder-Charakter dieser Frage weist darauf hin, dass etwas nicht stimmt. Nämlich unser Verständnis dessen, worum es eigentlich geht.

„Künstliche Intelligenz“ ist ein Begriff, über den man eigentlich nicht sprechen kann. Denn es handelt sich um einen Mythos. Ein Gespenst. In seinem Inneren wohnt ein Paradox; das, was der Systemforscher Niklas Luhmann einen „Kategorienirrtum“ nennt.

Menschen nehmen die Welt mit Sinnen und Körper wahr. Sie bilden Modelle über die Zukunft. Haben Zweifel, Gefühle, Körper und Bewusstsein. Das ermöglicht Differenzierungen, mit deren Hilfe man kreativ, variabel, lernend mit der Welt umgehen kann. Das ist das Wesen von Intelligenz.

Das Künstliche hingegen folgt vorgefassten Regeln. Es wiederholt sich selbst, in endlosen Schleifen. Es kennt keine Zweifel und verfolgt keine Pläne. Keine Hoffnungen, Irrtümer und Sehnsüchte. Es lernt nicht. Es kaut nur alles wieder.

Als verletzliche, sterbliche Wesen sehnen wir uns wie verrückt nach Wundern und Allmacht. Nach einer Instanz, mit der wir sprechen können, und die uns eine höhere Wahrheit verkündet. Wenn Gott tot ist, suchen wir die Antwort in Maschinen.

Wenn Maschinen mit uns sprechen, oder Bilder malen, dann glauben wir, dass sie etwas Intelligentes, Menschliches tun. Wir lassen uns hypnotisieren, in eine Täuschung, eine Euphorie ziehen. Wir betreiben Anthropomorphing.

„Anthropomorphismus bedeutet das Übertragen menschlicher Eigenschaften auf nichtmenschliche Entitäten – Wetter, Tiere, Pflanzen, Maschinen.“ (Wikipedia).

Der MIT-Forscher Joseph Weizenbaum wies diesen Effekt schon im Jahr 1966 mit seinem Programm ELIZA nach. Er war erschüttert, wie leicht sich Menschen durch simple Algorithmen täuschen ließen. ELIZA simulierte eine Therapie-Situation. Es verhielt sich wie ein Psychologe, der immer nur Fragen auf Stichworte stellte.

Benutzer: „Ich habe ein Problem mit meiner Mutter.“

ELIZA: „Erzählen Sie mir mehr über Ihre Familie!“

Allein, dass uns ein Programm Fragen stellt, erzeugt in unserem Hirn eine Zwischenmenschlichkeits-Illusion. Diese entwürdigende Verwechslung von „KI“ mit menschlichen Eigenschaften führt unter anderem dazu, dass wir uns vor dem Falschen fürchten. Bei der Einführung des Internets haben wir uns immerzu vor dem Überwachungsstaat gefürchtet. Vor Orwells „1984“, der Unterdrückung durch staatliche Kontrolle, der „Datendiktatur“. Dabei haben wir lange Zeit übersehen, dass mitten in unserer Kultur ein gigantischer Echoraum für Bösartigkeit, Betrug, Hass, Fälschung, Übertreibung und Aufmerksamkeits-Terrorismus entstand. Toxische Medialiät. Wir starrten in die falsche Richtung. Der französischer Soziologie Gérald Bronner nennt die Konsequenzen des „sozialen“ Internets eine „Kognitive Apokalypse“. Eine Zerstörung von Zusammenhängen, Bedeutungen und Beziehungen.

In Sachen Künstlicher Intelligenz wiederholt sich das Ganze. Die Übergriffigkeit. Die Illusionen. Die blinde Euphorie. In was lassen wir uns da hineinlocken? Und wie kommen wir da wieder raus?

2. Entwertung

Die eigentliche Frage lautet: Welche menschlichen Probleme gäbe es, die die eine „Künstliche Intelligenz“ tatsächlich sinnvoll lösen könnte?

Es gibt eine begrenzte, praktische, spezialisierte „KI,“ die für die Menschheit und den Fortschritt äußerst sinnvoll ist. Stellen wir uns ein System vor, das das Zusammenspiel von Millionen erneuerbarer Energiequellen steuern kann. Auf jedem Haus eine Solaranlage, überall Windstrom, Batteriesysteme – um auf diese Weise aus der fossilen Energiewelt auszusteigen, bräuchten wir kompetente Steuer-Systeme, die uns verlässlich mit Elektronen versorgen.

Oder ein System zur Konstruktion passgenauer Krebs-Medikamente im Rahmen der neuen CRISPR- und RNA-Techniken.

Solche Systeme können komplexe Probleme intelligent lösen. Aber sie wären nicht „an sich“ „intelligent“. Es sind Expertensysteme, Werkzeuge, die wir dringend brauchen, um in einer komplexe(re)n Welt zurechtzukommen.

Sie sprechen nicht mit uns. Sie tun nicht als ob. Sie machen ihren Job, und das ist gut so.

Bei den KI-Systemen, die jetzt veröffentlich werden, handelt es sich jedoch um semantische – oder generative – „Crawler“. Also um eine Software, die das Internet „durchkriecht“, alles in sich einsaugt, und daraus einen scheinbar autonomen Output generiert.

Die Software DALL-E malt Bilder. Das Grafikprogramm, hat über das Internet ALLE Bilddateien eingespeichert, die es überhaupt gibt. Alle Maler, alle Bilder, alle Stile, aller Zeiten. Es kann aus diesen gespeicherten Bildern Varianten bilden. In Sekundenschnelle zaubert es zum Beispiel auf den Befehl EINE STADT IM DALI-STIL eine Stadt hervor, in der lappende Uhren von den Häusern hängen.

Oder MALE EINEN HUND IN RITTERRÜSTUNG IM RENAISSANCE-STIL!. Geht ganz schnell.

Ein Wunder an Kreativität! Oder?

ChatGPT schreibt Texte und spricht „mit uns“. Zumindest hört es sich so an. Das Programm kann wunderschöne Gedichte im Shakespeare-Stil verfassen. Texte schreiben, die irgendwie an Doktorarbeiten erinnern. Oder zehntausend romantische Liebesbriefe schreiben – in 4,3 Sekunden.

Noch mehr Wunder!

Natürlich ist all das ein Irrtum. Eine Blendung. DALL-E kann kein einziges Kunstwerk hervorbringen, denn Kunst ist immer das Erzeugen von kreativer Differenz. Eines kognitiven Unterschieds in der menschlichen Wahrnehmung. DALL-E macht hingegen eine Art Malen nach Zahlen, greift dabei aber auf das genuine Kreative zurück – zerstört und dekonstruiert es.

ChatGPT erzeugt Texte durch probabilistische Schleifen, ähnlich wie bei einem Wortergänzungs-Programm im Smartphone. Es wird deshalb alle Klischees, Vorurteile, Dummheiten abbilden, die sich in den Myriaden von Texten im Internet abbilden. Und das Ergebnis wieder in seinen Speicher einspeisen …

Was entsteht, wenn man alle Farben und Formen zusammenrührt?

Grauer Brei.

Zehntausend künstliche Liebesbriefe haben nichts mit Liebe zu tun.

Sondern mit Verachtung.

Natürlich kennt die KI keine Verachtung. Diejenigen, die sie für bestimmte Zwecke nutzen werden, aber schon.

3. Enteignung

Sehr aufschlussreich für den Aufstieg und das Desaster der digitalen Plattform-Ökonomie ist die Serie „The Playlist“ auf Netflix. Gezeigt wird der spektakuläre Aufstieg von Spotify, der weltweiten Musikplattform aus Schweden. Und zwar aus 5 Perspektiven.

- Aus der Perspektive der Vision des Nerd-Gründers, der sich in seinem Computerkeller langweilt und die ungeheure Bedeutung von Musik für Jugendliche begreift.

- Aus der Perspektive des Startup-Investors, eines ziemlich schrägen Freaks mit den üblichen ADHS-Symptomen („Elon-Musk-Syndrom“).

- Aus der Perspektive der Rechtsanwältin, die mit den Musikproduzenten um die Musikrechte verhandelte.

- Aus der Perspektive eines Coders.

- Und aus der Perspektive einer talentierten Musikerin, die durch Spotify arm wurde. An diesem Punkt geht die Story in die Zukunft und spielt im Jahr 2024, wo ein weltweiter Aufstand der Musiker gegen Spotify stattfindet.

Der Film macht eine Art Prophezeiung, die auf das eigentliche Problem der Plattformökonomie hinweist.

Auch wunderbar erhellend: „WeCrashed“, über den spektakulären Aufstieg und Zusammenbruch von WeWork bei AppleTV. Ein Lehrstück über Startup-Gier.

Der gloriose Erfolg von Spotify konnte nur funktionieren, weil durch ein „disruptives“ Geschäftsmodell die Musiker, die Künstler, an den Rand des Marktes gedrängt wurden. Die Bedingungen, mit denen sich Spotify um 2010 die meisten Musikrechte kaufte, wurden von den großen Musikfirmen mit ihren mächtigen Anwälten diktiert. Die Tantiemen wurden meistens im Verhältnis 70 zu 30 verteilt (30 % für die Musiker). Spotify hat die Musikszene damit weiter gespalten. Das System hat statt einem ZWEI Intermediäre produziert: Spotify selbst als „Gatekeeper“. Und die großen Produzenten, die VOR Spotify durch Piraterie schon fast ausgestorben waren.

Man könnte das Grundprinzip des digitalen Über-Business PARASITÄRE DIGITALITÄT nennen. Im Unterschied zu einer konstruktiven Digitalität setzt sie keine kreativen Potentiale frei, sondern beutet sie aus. Und erzeugt dabei die ILLUSION von Kreativität.

Wenn wir darauf hineinfallen, sind wir selber schuld.

4. Verdrehung

Die amerikanische Tech-Website C-Net nutzt schon seit Jahren KI zum Erstellen von Grundtexten der Finanzberatung. Diese stellten sich jetzt als voll mit Verdrehungen und Fehlinformationen heraus. Der Aufwand solche Fehler zu finden und zu korrigieren, wird von den Redaktionen vermieden. Damit wäre ja der kostensparende Effekt von Text-KI hinfällig. Die Redakteure müssten das, was die Bots an Fehlern aus dem Netz ziehen, aufs Neue recherchieren und verifizieren.

Eine KI behauptete neulich, man dürfe nur Sudanesen, Israelis und Iren foltern. Woher sie das hatte, lässt sich nicht mehr vollständig nachvollziehen – solche Systeme sind eine Black Box.

Um derartigen Ausrutschern entgegenzuwirken, werden derzeit in Kenia Menschen an Bildschirmen für 2 Dollar pro Stunde damit beschäftigt, die gröbsten Fehler beim Sourcing der Künstlichen KI auszuschalten.

time.com/6247678/openai-chatgpt-kenya-workers

Spätestens an diesem Punkt erinnert das Ganze an die Versprechungen von Mark Zuckerberg, seine soziale Plattform „demnächst“ in einen Hort menschlicher Zuneigung zu verwandeln. Oder an die Filmserie MATRIX. Die KI-Systeme sind sichtlich schlauer geworden. Sie nutzen nicht die menschliche Körperwärme (wie in MATRIX) und versorgen die Hirne mit Illusionen, sondern sie beuten menschliche Arbeitskräfte aus, um sich selbst zu korrigieren.

Wie bizarr ist das denn?

Eine weitere Anwendung, die durch semantische KI ganz groß rauskommt, ist das, was man „Künstliche Höflichkeit“ nennen könnte. Neuerdings gehen große Hotelketten dazu über, Kundenbeschwerden mit Künstlicher Intelligenz zu beantworten. Wenn ein Kunde sich über kaputte Duschwannen oder ächzende Betten beschwert, folgt schon 5 Minuten später eine ausgewählt höfliche Entschuldigung, in der der Kunde überschwänglich für seinen Hinweis gelobt wird, mit dem Angebot einer Preisermäßigung und eines Upgrades.

Sind wir nicht Serienbriefe im Marketing schon lange gewohnt? Der Unterschied ist nur, dass die KI-Schein-Zuwendung massenhaft individualisieren kann. Eine Art neuer Enkeltrick.

Die erste Zerstörung, die die semantische KI anrichtet, ist die Zerstörung des Autorenprinzips.

Die zweite ist die Entwertung von Wahrheit als anstrebenswerte Kategorie.

Die dritte Zerstörung besteht in einem generellen Vertrauensverlust allen Kommunikationen und semantischen Produktionen gegenüber.

Ist das echt? Oder tut das nur so?

Redet der nicht schon wie eine KI?

DALL-E wird zunächst den kreativen grafischen Markt zerstören. Illustratoren, Zeichner, Designer werden es plötzlich sehr schwer finden, überhaupt noch Geld mit ihrer Kunst zu verdienen.

Dann sind Journalisten, Autoren, Texter an der Reihe. Und sogar Drehbuchschreiber, die aktuellen Helden der narrativen Kreativität. Speisen wir doch einfach die Algorithmen der erfolgreichsten Krimiserien, Komödien, Sci-fi-Stories in die Maschine – und lassen sie die OPTIMIERTESTE Krimiserie, Komödie, Sci-Fi-Serie ausrechnen!

Die mit den meisten Zuschauern.

Haben Sie manchmal das Gefühl, dass das längst der Fall ist?

Alle Filmserien verlaufen nach dem immergleichen Muster.

Optimiert.

Zu Tode optimiert.

Aber könnte es nicht wunderbare soziale Anwendungen der kommunikativen KI geben, die Bildungs- und Armutsprobleme lösen?

WEF-Gründer Klaus Schwab beschrieb die Entwicklung eines indischen Programmierers, die es Bewohnern eines abgelegenen indischen Dorfes ermöglichte, komplexe Behördendienste in Auftrag zu geben. Nur wenige Monate habe es gedauert von der Entwicklung des zugrundeliegenden KI-Modells in den USA bis zur konkreten Anwendung im ländlichen Indien.

Aber was heißt „komplexe Behördendienste in Auftrag zu geben“?

Ist es nicht das eigentliche Problem von Armut, dass man genau das nicht kann?

Wer also gibt hier den Auftrag?

Viele argumentieren: Die KI setzt Kreativität frei, indem sie Routinen routiniert. In den Schulen zwingt sie die Pädagogen, endlich das wahrhaft Kreative zu lehren. Information wird derweil von der KI vermittelt. Das scheint ein plausibler Gedanke. Er basiert aber wiederum auf einem Kategorienfehler. Wissen ist keine „Information“. Sondern ein durch menschliche Kommunikation und emotionale Übertragung erzeugter Zusammenhang.

Bildung ist Erfahrung, Intuition, Beobachtungs-Kompetenz, die durch menschliche BEGEGNUNG entsteht.

Kreativität ist die Fähigkeit, mit Wissen fragend umzugehen.

Menschen sind Begegnungs-Wesen. Jeder weiß das, der einen Lehrer/eine Lehrerin hatte, der – ein echtes Wunder! – das Feuer der Physik, der Astronomie oder sogar des Lateins entzünden konnte.

KI in der Schule wird das heute schon gefährliche Halbgoogeln in ungeahnte Dimensionen steigern. Die Nichtkompetenzen unerträglich vermehren.

Semantische KI schürt die Illusion, nichts wissen zu müssen, weil man alles abfragen kann.

Wenn wir rasend schnell Antworten aller Art erhalten – wozu sollen wir Fragen finden, die uns interessieren?

Und jetzt sollen wir auch noch kreativ sein? Nein Danke!

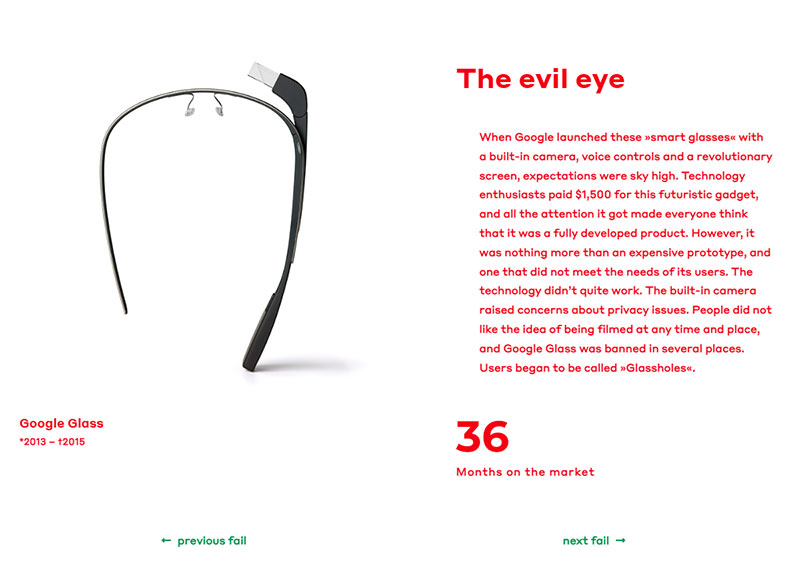

5. Eine kleine Floppologie

Wir vergessen gerne die digitalen Flops. Dabei sind Flops, als Beispiele für Marktversagen, besonders lehrreich. Sie zeigen uns, wo Technologie an ihre menschlichen oder systemischen Grenzen gerät. Und womöglich auch, wie wir Technologie besser, sinnvoller einsetzen und entwickeln könnten.

Nicht funktioniert haben die ulkigen intelligenten Roboter-Kisten, die autonom Güter in den Städten ausliefern sollten. Erinnern Sie sich? Eine Zeitlang war das die Superstory auf Investoren-Konferenzen. Von den Dingern ist ebenso wenig zu sehen wie von den Drohnen, die uns die Pizza auf den Balkon liefern sollten. Wer möchte schon dauernd über Roboterwägelchen stolpern oder unter einem surrenden Drohnenhimmel leben? Zumal in Zeiten des Ukraine-Krieges …

Hätte man das nicht gleich wissen können?

Google Glass, einer der „Besten Erfindungen des Jahres 2012“ (TIME Magazin), war die erste Augmented-Reality-Brille auf dem Markt. Dem Gerät schwappte eine Hasswelle entgegen. Auf vielen Cafétüren in den Hip-Metropolen stand das Motto „No Glassholes!“ – Keine arroganten Idioten mit AI-Brille erlaubt! Was die Konstrukteure nicht erahnten und verstanden, war der psychologische Abwehreffekt, den das Gerät in sozialen Situationen hervorrief. Du weißt etwas, was ich nicht weiß – und verweigerst damit menschliche Kommunikation auf derselben Ebene!

Dennoch hält sich der AR-Hype bis heute, zäh wie ein Dreiwochen-Kaugummi. „Ich bin begeistert von AR“, verriet der Apple-CEO Tim Cook auf einer Preisverleihung in Irland 2018. „Ich glaube, das wird das nächste große Ding und unser komplettes Leben durchdringen. Wir können über einen Artikel sprechen, und zu gleichen Zeit die gleiche Sache betrachten. Oder man liegt unter dem Auto und wechselt das Öl. Wenn man nicht sicher ist, wie das geht, kann man AR benutzen.“

Wirklich? Wahrscheinlich hat Tim Cook niemals einen Ölwechsel an seinem Auto gemacht. Und haben wir nicht längst ganz andere Probleme?

Too much information.

Information overload!

(Anmerkung: AR-Systeme sind sehr sinnvoll in komplexen professionellen Orientierungs-Situationen: bei Operationen, in Laboren, bei komplexen Lager-Logistiken, in Reinraum-Fabriken etc.)

Im Jahr 2014 machte der erste „Emotionale Heimroboter“ in den USA Schlagzeilen. JIBO, ein niedliches Gerät für den Wohlfühl-Bereich, mit einem einzigen Auge, das Blinzeln, Zwinkern und sogar böse gucken konnte. JIBO konnte reden, Lieder mit der Familie singen, Fotos machen und den Kindern Gutenachtgeschichten vorlesen. Er brachte es als Erfindung des Jahrhunderts auf die Titelseite des TIME Magazins, als erster „menschlich kommunizierender Computer“. Entworfen wurde er von Cynthia Breazeal, einer MIT-Forscherin, die sich auf emotionale Mensch-Maschine-Kommunikation spezialisiert hatte. Nach etwa 6.000 Auslieferungen des Geräts war Schluss. Die User nahmen das ständige Emotionalisieren von JIBO als nervend und übergriffig wahr.

Den Einsamen machte das Ding ihre Einsamkeit nur noch deutlicher.

Gescheitert ist im Grunde auch das autonome Autofahren – jedenfalls auf absehbare Zeit. Nicht nur, weil uns Elon Musk mit diesem feuchten Traum einfach an der Nase herumgeführt hat. Damit alle Autos autonom herumfahren könnten, müsste man zuerst die Städte, Straßen, die gesamte öffentliche Infrastruktur „autonomfahrgerecht“ umbauen. Eine Welt nur für die Sensoren von Autos konstruieren. Sonst wird es nicht gehen, denn der moderne Verkehr ist ungeheuer komplex. Autonomes Autofahren würde also wieder zu einem MATRIX-Effekt führen: Die Maschinen bauen UNSERE Umwelt in ihrem Sinne um.

Abgesehen davon halten 80 Prozent aller männlichen Autofahrer (90 Prozent der weiblichen) die Idee, das Steuer loslassen zu sollen, für eine blöde Idee.

(Was nicht heißt, dass es nicht in sauber geplanten chinesischen Städten, amerikanischen Vorstädten oder abgegrenzten Arealen Inseln autonomen Verkehrs geben kann.)

Und so sind die digitalen Über-Versprechen reihenweise gescheitert oder tief in die Krise geraten. Die Idee, Krypto-Geld mit gewaltigen (meist fossil betriebenen) Rechenzentren herzustellen und damit reich und sexy zu werden, ist zumindest an ihre Grenzen gestoßen. Gescheitert am Markt sind NFTs, jene Besitzcodes für Kunst, deren Sinn von Anfang an niemand verstand. Gescheitert ist Twitter als demokratisches Debattier-Medium. Gescheitert, jedenfalls in der breiten Anwendung, sind die „intelligenten Sprachassistenten“ – die Vorläufer der Sprachbots. Alexa und Siri werden für Wetterberichte oder Plattensammlungen benutzt, kaum für mehr. Die Amazon-Sprachassistenten-Unit machte 2022 10 Milliarden Dollar Verlust. Ein großer Teil der Mitarbeiter musste gehen.

Weitgehend gescheitert ist Second Life, der Vorläufer des gloriosen METAVERSE. Lag es nur darin, dass es zu wenige Polygone zeichnen konnte?

Ein stockender Markt sind auch die gloriosen VR-Brillen. Jetzt bringt Sony sein neues Modell VR2 auf den Markt. Warum will der Entertainment-Cyberspace einfach kein Massenmarkt werden? Wollen wir nicht alle auf schönen, bunten Planeten mit Zauberern den coolen Monstern entkommen? Wer schon einmal eine Außenbord-Operation an der ISS mit 3-D-Brille gemacht hat (ich habe das), weiß, wo die Grenzen liegen. Es ist wahnsinnig anstrengend. Der Cyberspace macht Übelkeit und Kopfweh, auch und GERADE, wenn er hoch aufgelöst ist. Nach einer halben Stunde Wunderwelt sehnt man sich zurück in die verdammte Realität, in der man Dinge spüren, fühlen, riechen kann. Und festen Boden unter den Füssen hat. Computerpsychologen sprechen von der Realitäts-Nostalgie.

Die Flops erzählen uns Geschichten über die Grenzlinien zwischen HUMANUM und TECHNIKUM. Allerdings muss man diesen Geschichten auch zuhören und sie genau verstehen, um etwas über die Zukunft zu erfahren.

Viele superdigitale Angebote, die heute auf den Markt kommen, sind keine Technologien, die menschliche Probleme lösen sollen. Sondern Technologien auf der verzweifelten Suche nach Problemen.

Semantische KI kann eigentlich keine wirklichen Probleme lösen. Sie kann weder Informationen besser auslesen, denn sie hat kein Kriterium für Wahrheit und Richtigkeit, die Irrtümer korrigieren könnte. Noch kann sie Kreativität ermöglichen. Sie kann all das nur simulieren, was sie zu „tun“ vorgibt.

Allerdings kann sie neue Probleme schaffen, die sie dann gegen Gebühr zu lösen vorgibt.

Und vielleicht geht es genau darum.

Die Anbieter arbeiten gerade an einer Software, die feststellen kann, ob ein Text von einer KI oder einem Menschen geschrieben wurde. Die Genauigkeit beträgt allerdings nur 30 Prozent. Wer höhere Genauigkeit will, muss demnächst ein UPGRADE zahlen.

Das klingt nach einem echten Geschäftsmodell.

6. Die Fortschrittsfalle

Wird es gelingen, die semantische KI aufzuhalten, oder wenigstens abzubremsen, bis wir ihre Anwendungen sinnvoll differenzieren können?

Diese Illusion sollten wir uns nicht machen.

Der technische Fortschritt verläuft, wie die ganze menschliche Geschichte, nach den blinden Evolutions-Gesetzen von trial and error. Technologien setzen sich nicht in Formen der PRÄstabilisierung durch (ein Begriff des Philosophen Leibnitz), also durch Planung, Voraussicht, Integration. Sondern durch REstabilisierung. In der Bewältigung von Krisen und Fehl-Anwendungen, die mit ihnen erzeugt werden.

Mit anderen Worten: Erst im Scheitern werden wir klüger.

Hoffen können wir auf das Immunsystem der menschlichen Kultur. Es gibt im Umgang zwischen Mensch und Maschine einen Effekt, den Computerforscher „Uncanny Valley“ nennen. Das unheimliche Tal.

Wenn Menschen mit sehr menschenähnlichen Maschinen konfrontiert werden, etwa mit täuschend echt aussehenden humanoiden Robotern, entsteht Ekel. Eine innere Abwehr. Dieser Effekt könnte auch zu einer Art Immunreaktion gegen die semantische KI führen. Gegen die Einsamkeit, in die uns „denkende Maschinen“ stürzen.

So, wie es heute einen Trend zur Fleischverweigerung gibt, könnte es auch eine Anti-KI-Bewegung geben.

Nein, ich rede nicht mit Maschinen. Grundsätzlich nicht.

Kann ich jetzt bitte einen REALEN Mitarbeiter sprechen?

Nein? Dann danke ich für dieses Gespräch. Auf Nimmerwiedersehen.

Jeder Trend, der über-mächtig zu werden droht, erzeugt irgendwann einen Gegentrend.

Immer mehr Menschen versuchen derzeit, der Über-Digitalisierung zu entkommen. Den Algorithmen, die unser kommunikatives Leben in hysterische Aufmerksamkeits-Spiralen, Stress und Oberflächlichkeiten verwandelt haben, zu entfliehen.

Immer mehr Menschen verstehen, dass digitale Technologien keine Demokratien retten, Krankenhäuser verbessern oder die Klimaerhitzung stoppen können. Noch nicht einmal eine kaputte Heizung können sie reparieren. Darauf wird es aber in Zukunft besonders ankommen: Die Dinge reparieren.

Wir können auf Gegen-Rebellionen hoffen. Wenn jeder Text nur noch banal ist, alle Bilder nur noch Abklatsch sind – dann wird das ORIGINAL wieder begehrenswert.

Es ist gut möglich, dass der KI-Hype der letzte Größenwahn des Digitalismus ist. Ein lustiges, bizarres Spielzeug, das bald wieder in den Schubladen oder Kellern verschwindet wie sprechende Puppen oder Roboter mit Wackelaugen.

Danach kommt nur noch der magische Quantencomputer, der uns verspricht, schneller rechnen zu können als das Universum selbst.

Vielleicht müssen wir durch diese Versuchung hindurch.

Aber vielleicht müssen wir nicht unbedingt mit Karacho hineinfahren.

Uns festkleben an der Illusion, dass man das genuine Menschliche den Maschinen überlassen kann.

Wie sagte Henry David Thoreau so schön im Jahr 1837?

„Wenn irgendein wirklicher Fortschritt gemacht wird, verlernen und erlernen wir aufs Neue das, von dem wir dachten, wir wüssten es längst.“

Pressezitate

In a new blog post, the company admitted that its Bing Chat feature is not really being used to find information – after all, it’s unable to consistently tell truth from fiction – but for „social entertainment“ instead.

„The model at times tries to respond or reflect in the tone in which it is being asked to provide responses that can lead to a style we didn’t intend,“ the company wrote. „This is a non-trivial scenario that requires a lot of prompting so most of you won’t run into it, but we are looking at how to give you more fine-tuned control.“

The news comes after a growing number of users had truly bizarre run-ins with the chatbot in which it did everything from making up horror stories to gaslighting users, acting passive-aggressive, and even recommending the occasional Hitler salute.

Wofür nutzen wir die künstliche Intelligenz von ChatGPT wirklich?

Erste Erkenntnisse stellen der Menschheit kein gutes Zeugnis aus.

von Michael Moorstedt

Innerhalb weniger Wochen nach ihrer Veröffentlichung haben mehr als hundert Millionen Menschen die KI namens ChatGPT benutzt. Um auf eine derartige Verbreitung zu kommen, haben andere Angebote, die heute das Internet prägen, Jahre gebraucht.

Inzwischen wird eifrig daran gearbeitet, die Anwendung in die bekannten Suchmaschinen- und Officeprogramme zu integrieren. Google kündigte in der vergangenen Woche seine eigene Chat-KI namens Bard an. Von einem KI-Wettrüsten ist schon die Rede. Die Nachrichten, wie sagt man, sie überschlagen sich. Und es festigt sich die Ahnung, dass sich die Art und Weise, wie Menschen Informationen organisieren, grundlegend ändern könnte. Im besten Fall würde diese neue Art der Suche nicht nur Links liefern, durch die sich die Nutzer dann selbständig klicken müssen, sondern gleich fertige Handlungsanweisungen: Computer, was soll ich tun?

Der US-amerikanische Autor und Unternehmer John Battelle hat die bei Google und Co. millionenfach und im Sekundentakt eingegebenen Anfragen einmal als „Datenbank der Intentionen“ bezeichnet. „Diese Informationen stellen in zusammengefasster Form einen Platzhalter für die Absichten der Menschheit dar – eine riesige Datenbank mit Wünschen, Bedürfnissen und Vorlieben, die aufgespürt, vorgeladen, archiviert, nachverfolgt und zu allen möglichen Zwecken ausgebeutet werden kann“, schrieb Battelle. Und weiter: „Ein solches Ungeheuer hat es in der Kulturgeschichte noch nie gegeben, aber es wird von heute an mit Sicherheit exponentiell wachsen. Dieses Artefakt kann uns außergewöhnliche Dinge darüber sagen, wer wir sind und was wir als Kultur wollen.“

Die Absichten und Vorsätze der Welt – hier sieht man sie ungeschönt.

Statt kollektiver Selbsterkenntnis entstand mit der Suchmaschinenoptimierung dann freilich eine riesige Nischenindustrie, die sich darauf versteht, ohnehin populäre Themen weiter zu verstärken und die kollektive Aufmerksamkeit der Nutzer zu Marketingzwecken zu steuern.

Wird es mit der neuen Technologie anders? Lässt sie mehr Selbsterkenntnis zu? Auf der Website showgpt.co kann man nachlesen, was sich die Nutzer von der KI wünschen. Hier werden die Prompts genannten Anweisungen, die andere Nutzer in die Chatzeile tippen, auszugsweise veröffentlicht. Nach einer schnellen Durchsicht ergibt sich ein sehr heterogenes Stimmungsbild: Jemand möchte eine Zusammenfassung von „Moby-Dick“ für die morgige Buchpräsentation. Ein anderer wünscht sich ein fiktives Streitgespräch zwischen Schopenhauer und Nietzsche, darüber, wer der bessere Philosoph war. Die Szene solle bitte in einem Faustkampf enden. Manches ist bemerkenswert einfallslos, wie jener Nutzer, der der KI den Satz „Kannst du neue Geschäftsideen ohne Geld?“ diktiert.

Philosophie-Fanfiktion und fauler Businesszauber – soll es das mit den kulminierten Absichten und Vorsätzen der Menschheit gewesen sein? In Wahrheit muss man nur mal wieder dem Geld folgen. Welche Anwendungen auf Basis künstlicher Intelligenz sind in den vergangenen Wochen und Monaten neu aufgetaucht? Wofür würden die Menschen bezahlen? Was ist, wie es in der Branche heißt, die Killer-App?

Da wäre zum Beispiel bedtimestory.ai. Für eine monatliche Gebühr von 9,99 US-Dollar können gestresste, aber zahlungskräftige Eltern die KI personalisierte Gutenachtgeschichten für ihre Kinder erstellen lassen. In einer ganz anderen Lebenssituation befinden sich wahrscheinlich die Nutzer eines Programms namens Keys. Mit der kann man von der KI erstellte Texte in Dating-Apps nutzen. Die Software reagiert entweder auf die Nachrichten der Person von Interesse, schlägt aber auch flotte Eisbrecher-Sätze oder – am anderen Ende der Konversation – diplomatische Schlussmachformulierungen vor.

Auch wenn die beiden Beispiele sehr unterschiedlich wirken, verdeutlichen sie sehr gut ein Problem. Aus Gründen intellektueller Faulheit versucht man selbst in intimsten Momenten genau die Dinge auszulagern, wegen derer das Leben überhaupt erst bedeutsam wird. Da taucht gleich noch eine Frage an die KI auf: Computer, wann wirst du mich überflüssig machen?

Quelle: Süddeutsche Zeitung, 13. Februar 2023

© Wikimedia Commons

© Wikimedia Commons